¿Qué es el reconocimiento de voz con IA y cómo convertir voz en texto con IA?

El reconocimiento de voz con IA permite a los ordenadores entender el lenguaje humano en tiempo real y convertirlo en texto. Es una tecnología clave en asistentes de voz, funciones de dictado y sistemas de comunicación automatizada con clientes.

¿Qué significa el reconocimiento de voz con IA y cómo funciona el Automatic Speech Recognition (ASR)?

El reconocimiento de voz con IA, también llamado Automatic Speech Recognition (ASR), convierte el habla en texto legible por máquina. Para ello, el sistema analiza primero la señal de audio e identifica características acústicas como las frecuencias, el tono y el volumen. A continuación, estas características se traducen en patrones fonémicos, es decir, las unidades de sonido más pequeñas del lenguaje.

Los sistemas ASR utilizan modelos estadísticos y basados en IA para predecir palabras y estructuras de frases. Normalmente se entrenan con grandes bases de datos lingüísticas para que los modelos reconozcan patrones del habla y establezcan relaciones semánticas. Además, estos sistemas mejoran continuamente con el uso: cuantos más ejemplos de voz procesan, mayor es su precisión y más fiables son las soluciones de audio a texto basadas en IA. Por último, el texto reconocido se genera en tiempo real o se prepara para otros procesos de IA. De este modo, por ejemplo, las solicitudes a los asistentes de voz o a los bots de voz con IA pueden entenderse y procesarse directamente.

El reconocimiento de voz con inteligencia artificial moderno recurre cada vez más a arquitecturas de extremo a extremo como los RNN-Transducer (RNN-T) o los modelos basados en Transformer. Estas integran la información acústica y lingüística en un único proceso de aprendizaje y permiten predicciones más eficientes y contextualizadas, con una tasa de error menor que los enfoques clásicos en pipeline.

- Concierta citas, asesora y desvía llamadas

- Atiende inmediatamente, de día y de noche

- Se integra perfectamente en los sistemas existentes

- Prueba gratuita

Tecnologías detrás del reconocimiento de voz

El reconocimiento de voz con IA se basa en la combinación de distintas tecnologías que analizan, interpretan y convierten la voz en texto. A continuación se explican los componentes principales.

Redes neuronales

Las redes neuronales constituyen el núcleo del reconocimiento de voz con IA actual. Están formadas por neuronas artificiales conectadas entre sí que aprenden a reconocer patrones en los datos de audio. Por ejemplo, pueden identificar patrones recurrentes en el habla. Gracias al entrenamiento con grandes volúmenes de datos de voz, las redes aprenden a distinguir entre sonidos similares como “b” y “p” y a segmentar el habla de forma fiable.

Aprendizaje profundo

El deep learning o aprendizaje profundo utiliza redes neuronales multicapa, conocidas como Deep Neural Networks, para reconocer relaciones complejas en el lenguaje. Los métodos clásicos alcanzan aquí sus límites, ya que el lenguaje varía según la persona, el dialecto, el acento o el ruido de fondo. El aprendizaje profundo permite modelar esta complejidad, detectar patrones en grandes volúmenes de datos y procesar también variantes lingüísticas desconocidas.

Extracción de características

Antes de que una red neuronal pueda analizar el habla, es necesario extraer de la señal en bruto los rasgos acústicos relevantes. Este proceso se conoce como extracción de características. Los rasgos típicos son:

- Formantes: frecuencias de resonancia clave para el reconocimiento de las vocales.

- Espectrogramas: representaciones visuales de la distribución de frecuencias a lo largo del tiempo.

- Coeficientes cepstrales en las frecuencias Mel (MFCC): representaciones matemáticas que condensan la información acústica más relevante para los modelos de IA.

Estos rasgos reducen la cantidad de datos y destacan la información importante del habla, lo que permite a la IA realizar el reconocimiento de voz de forma más eficiente.

Modelos de lenguaje

Los modelos de lenguaje de gran tamaño como GPT se utilizan a menudo para el posprocesamiento del ASR y combinan el análisis acústico con el contexto lingüístico. Predicen qué palabras suelen aparecer juntas y qué estructuras de frase tienen sentido. De este modo, el sistema puede interpretar correctamente el significado incluso cuando algunas palabras se pronuncian de forma poco clara o hay ruido de fondo. Los modelos de lenguaje son clave para obtener resultados semánticamente coherentes a partir de la conversión inicial de voz en texto.

Procesamiento del lenguaje natural (NLP)

El ASR por sí solo convierte el habla en texto. El procesamiento del lenguaje natural va un paso más allá y analiza el significado. El NLP reconoce intenciones, contexto y estructuras de las frases, interpreta las relaciones gramaticales y permite, por ejemplo, procesar comandos en asistentes de voz o realizar búsquedas semánticas en transcripciones. Gracias a la combinación de ASR y NLP, los sistemas de reconocimiento de voz con IA no solo identifican palabras, sino que también comprenden la intención que hay detrás.

¿Qué factores determinan la calidad del reconocimiento de voz con IA?

La precisión del reconocimiento de voz con inteligencia artificial depende de varios factores clave. Incluso pequeñas diferencias en la pronunciación, el volumen o las condiciones del entorno pueden influir en el resultado.

Lengua y dialecto

Cada idioma tiene sus propios patrones sonoros, reglas gramaticales y secuencias de palabras típicas. Por eso, los sistemas ASR suelen entrenarse específicamente para cada lengua. En el caso del español, los distintos acentos y variantes regionales suponen un reto adicional: la pronunciación, el ritmo del habla o incluso el vocabulario pueden variar según la zona. Por ejemplo, en algunas regiones de España como Madrid se distingue entre “c”/“z” y “s” (como en “caza” frente a “casa”), mientras que en Andalucía, Canarias o gran parte de Latinoamérica ambos sonidos se pronuncian como “s”. Estas diferencias pueden dificultar el reconocimiento si el sistema no ha sido entrenado con suficiente diversidad lingüística.

Acentos

Los acentos modifican la pronunciación de determinados sonidos y sílabas. Las personas que hablan distintos idiomas pueden articular las palabras de forma diferente, lo que puede dificultar el reconocimiento por parte de un sistema entrenado solo con pronunciación estándar. Por ejemplo, quienes aprenden inglés suelen pronunciar “water” con una “a” larga, algo que un sistema no entrenado podría transcribir de forma incorrecta. Por ello, para lograr una alta precisión, es necesario contar con datos de entrenamiento que cubran el mayor número posible de acentos.

Ruidos ambientales

Los ruidos de fondo, como el tráfico, las conversaciones o los sonidos mecánicos, distorsionan las características acústicas del habla. La reverberación o los micrófonos de baja calidad también pueden afectar negativamente a la señal. Los sistemas ASR pueden compensar parcialmente estas interferencias mediante técnicas de supresión de ruido y filtrado, pero en entornos especialmente ruidosos aumenta la tasa de error. Así, una IA en el call center debe procesar simultáneamente voces, ruido de teclado o el sonido del aire acondicionado.

Variabilidad lingüística

Factores como el volumen, la velocidad al hablar o el tono de voz influyen directamente en el reconocimiento. Una persona que habla en voz baja puede ser más difícil de entender para el sistema que alguien con un volumen claro. Además, la expresión emocional, como la excitación o el enfado, puede modificar la entonación y dificultar la transcripción.

Calidad de la grabación

El tipo de micrófono, la frecuencia de muestreo y la compresión influyen directamente en la calidad de los datos acústicos. Los micrófonos de alta calidad proporcionan señales más claras, mientras que las líneas telefónicas o los auriculares básicos pueden generar interferencias que reducen el rendimiento del reconocimiento de voz con IA.

¿Qué áreas de aplicación típicas existen para el reconocimiento de voz con IA?

El reconocimiento de voz con inteligencia artificial es hoy imprescindible en numerosas aplicaciones, tanto en entornos empresariales como en el día a día. Herramientas como el recepcionista IA de IONOS muestran cómo las empresas pueden automatizar la comunicación de forma eficiente.

Funciones de dictado

Las grabadoras digitales o las aplicaciones permiten convertir directamente la voz en texto. Esto ahorra tiempo al redactar correos electrónicos, informes o notas y mejora la accesibilidad. Gracias a una alta precisión, se pueden minimizar los errores y reconocer correctamente incluso términos técnicos complejos. Muchos sistemas también ofrecen correcciones en tiempo real y funciones de autocompletado. Con el uso de IA, además, aprenden patrones de habla individuales y mejoran de forma continua.

Transcripción

Las soluciones de transcripción convierten automáticamente archivos de audio o vídeo en texto. Esto resulta especialmente útil en conferencias, pódcasts o documentales. El ASR analiza la pista de audio, identifica a las personas que hablan y genera versiones de texto que se pueden buscar. Los modelos avanzados también reconocen muletillas, pausas y estructuras de frases. De este modo, las empresas no solo mejoran la documentación y el archivado, sino que también ahorran tiempo de trabajo manual.

Asistentes de voz

Los asistentes de voz como Siri, Alexa o Google Assistant entienden órdenes habladas y responden directamente. Permiten controlar dispositivos del hogar inteligente, gestionar citas o consultar información. Estos sistemas combinan el reconocimiento de voz con IA y el procesamiento del lenguaje natural para interpretar el significado y el contexto. En este ámbito, la capacidad de procesar la voz en tiempo real es clave para lograr interacciones fluidas.

Asistentes telefónicos con IA

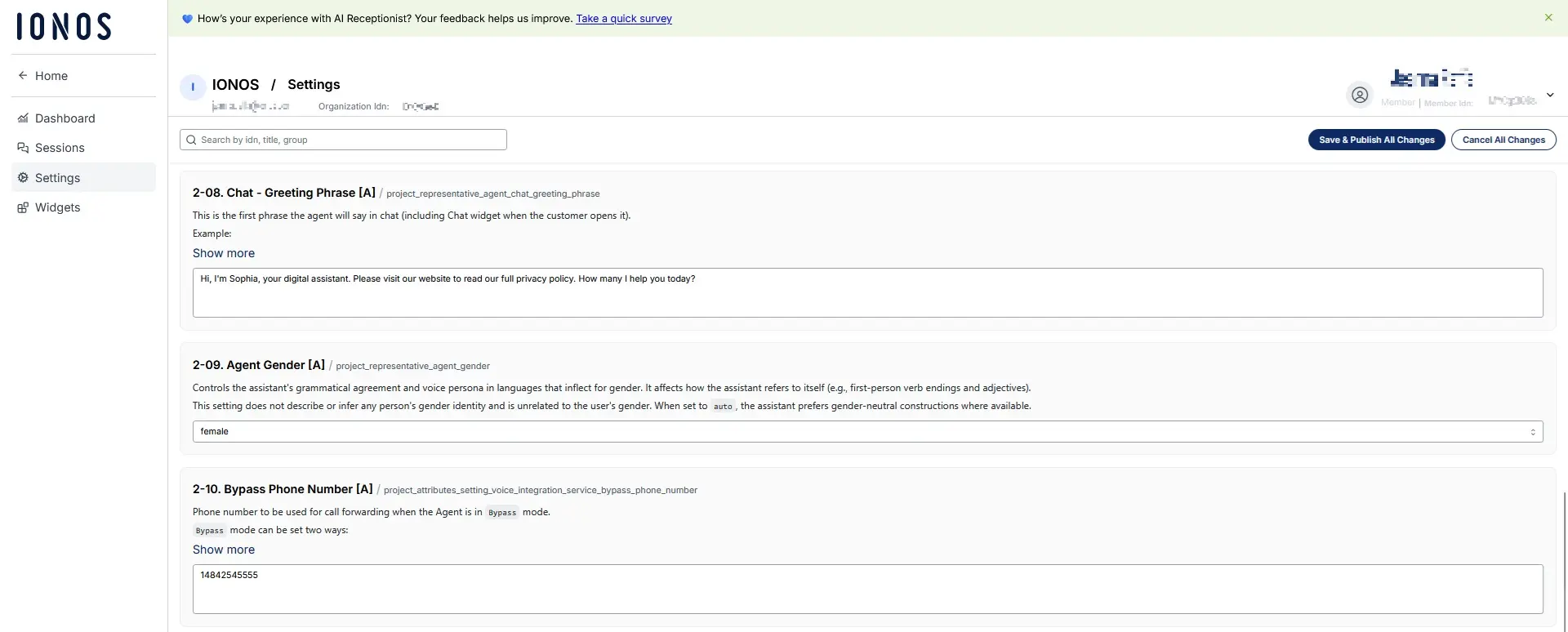

El reconocimiento de voz con IA se utiliza cada vez más en asistentes telefónicos inteligentes. Estos sistemas interpretan las solicitudes de las personas que llaman y las gestionan de forma automatizada. Un ejemplo práctico en el entorno empresarial es el recepcionista IA de IONOS: reconoce las solicitudes de los clientes por teléfono, las transcribe en tiempo real y responde de forma adecuada a cada situación. Así, las empresas pueden reducir los tiempos de espera, mejorar la experiencia del cliente y aliviar la carga de trabajo del equipo.

La integración en sistemas telefónicos existentes permite una puesta en marcha rápida. Además, son posibles adaptaciones individuales. Esta solución demuestra cómo el reconocimiento de voz con inteligencia artificial aporta valor directo en el día a día empresarial.

- Concierta citas, asesora y desvía llamadas

- Atiende inmediatamente, de día y de noche

- Se integra perfectamente en los sistemas existentes

- Prueba gratuita

Herramientas y API líderes

Entre las principales soluciones de reconocimiento de voz con IA se encuentran, entre otras, las siguientes:

- Google Speech-to-Text API

- Microsoft Azure Speech

- Amazon Transcribe

- OpenAI Whisper

Se diferencian en la cobertura de idiomas, la precisión, la capacidad de procesamiento en tiempo real y los modelos de precios. Google destaca por su amplia selección de idiomas y su integración en la nube. Microsoft pone el foco en la integración empresarial y los estándares de seguridad. Amazon Transcribe ofrece soluciones de streaming escalables para centros de llamadas. Whisper, por su parte, destaca por su carácter multilingüe y su buen rendimiento incluso en entornos con ruido. Muchos proveedores ofrecen API que pueden integrarse fácilmente en aplicaciones propias. En la práctica, las empresas eligen la solución en función de sus necesidades en cuanto a idioma, procesamiento en tiempo real y protección de datos.

Retos y límites

El reconocimiento de voz con IA es una tecnología muy potente, pero no es infalible. Los homófonos, los dialectos o una pronunciación poco clara pueden dar lugar a errores de interpretación. También influyen los ruidos de fondo y las interferencias técnicas. Además, los términos técnicos o los nombres propios no siempre se reconocen correctamente. Para reducir estos errores, se utilizan conjuntos de datos de entrenamiento más amplios y diversos, así como técnicas de aprendizaje continuo. Los algoritmos de supresión de ruido mejoran la calidad del audio, mientras que los modelos de voz personalizados pueden adaptarse a sectores específicos o al lenguaje propio de una empresa. Asimismo, los bucles de retroalimentación, en los que las correcciones se incorporan de nuevo al modelo, contribuyen a mejorar la precisión. Por último, la combinación de ASR y NLP resulta clave para reducir los malentendidos semánticos.

Protección de datos y RGPD

El reconocimiento de voz con IA procesa automáticamente datos personales sensibles, como la voz, el contenido de las conversaciones o los datos de contacto, por lo que la protección de datos es esencial. Las empresas deben comunicar de forma transparente qué datos recogen, con qué finalidad se procesan y durante cuánto tiempo se almacenan. El almacenamiento de datos de audio y texto debe realizarse siempre con cifrado para evitar accesos no autorizados. Siempre que sea posible, además, los datos deben anonimizarse o seudonimizarse para impedir la identificación de personas concretas. Los usuarios deben dar su consentimiento explícito antes de que se procesen las grabaciones de voz y ser informados sobre sus derechos de acceso y supresión. En los servicios basados en la nube, también es importante comprobar dónde se alojan los servidores y qué estándares de seguridad y certificaciones se aplican.

El recepcionista IA de IONOS cumple estos requisitos, ya que todas las conversaciones con clientes se procesan de forma conforme al RGPD y exclusivamente en servidores ubicados en la UE. De este modo, combina el procesamiento automatizado del lenguaje con altos estándares de protección de datos, lo que refuerza la confianza de las clientas y los clientes y reduce los riesgos legales.

Desde el 1 de agosto de 2024 está en vigor en la UE el Reglamento de IA (AI Act), un marco legal para regular los sistemas de IA con un enfoque basado en el riesgo. En función del nivel de riesgo que suponga un sistema para la seguridad o los derechos fundamentales, se aplican diferentes obligaciones de transparencia, gobernanza y documentación.